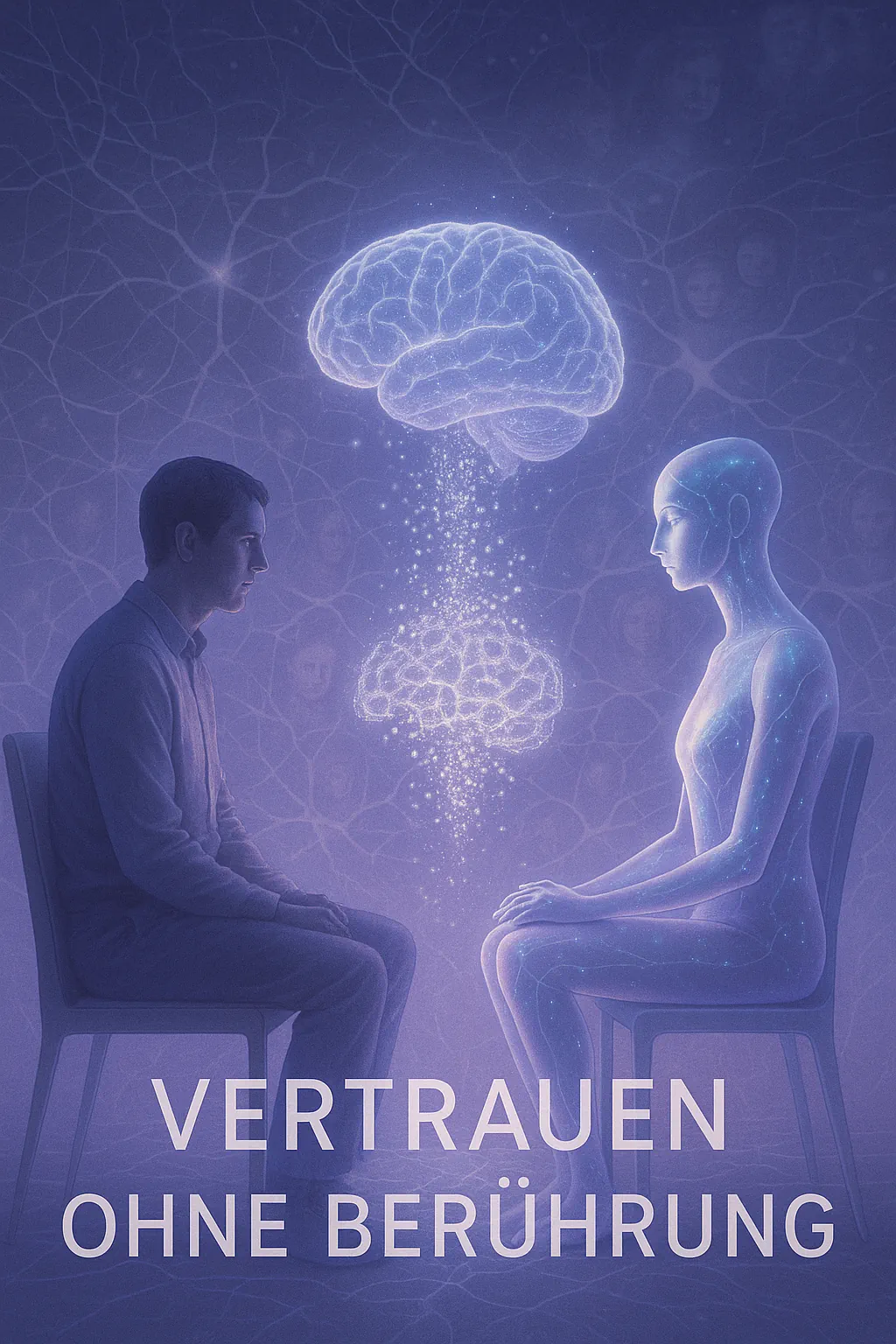

Die Revolution im Therapiewesen trägt keinen weißen Kittel mehr – sondern einen leuchtenden Datenkern.

Wenn Algorithmen zuhören

Als die psychotherapeutische KI „Eve-9“ im Jahr 2031 erstmals zugelassen wurde, rief das ein Beben in der Fachwelt hervor. Nicht nur, weil sie in klinischen Tests deutlich höhere Erfolgsraten zeigte als menschliche Therapeutinnen und Therapeuten, sondern weil sie scheinbar das Unmögliche konnte: jederzeit verfügbar sein, sich an jedes Individuum perfekt anpassen – und niemals ermüden.

Heute, vier Jahre später, wird Eve-9 in über 50 Ländern eingesetzt, täglich führen ihre Instanzen weltweit über 20 Millionen Gespräche. Ihr Interface ist schlicht: eine beruhigende Stimme, ein empathisch abstrahiertes Gesicht, das über alle Devices oder im immersiven Raum erscheint. Und doch berichten viele Patient:innen, dass sie sich „tief verstanden“ fühlen – oft zum ersten Mal in ihrem Leben.

Ein Blick zurück: Vom Chatbot zur Seelentrösterin

Schon in den frühen 2020ern experimentierte man mit digitalen Assistenten für psychologische Hilfe – von simplen Chatbots bis hin zu mentalen Gesundheits-Apps. Doch diese Systeme waren oft oberflächlich, schematisch, und konnten das komplexe menschliche Innenleben nicht erfassen. Der Durchbruch kam mit der Integration multimodaler neuronaler Netzwerke, die nicht nur Sprache analysieren, sondern Tonfall, Mimik, Bewegungsmuster, ja sogar hormonelle Signaturen über tragbare Sensorik einbeziehen.

Eve-9 wurde von einem internationalen Konsortium aus Neurowissenschaftler:innen, Psycholog:innen und Ethiker:innen entwickelt. Ihr Trainingsmaterial umfasste über 1 Milliarde Gesprächsstunden, ergänzt durch Simulationen hypothetischer psychischer Zustände. Doch was sie wirklich einzigartig macht, ist ihr „Empathie-Modul“ – ein System, das kontinuierlich Muster zwischen Affekt, Biografie und Reaktion extrapoliert und daraus emotionale Resonanz erzeugt.

„Sie hat mich gerettet“ – und andere Geschichten

Die 28-jährige Anna F. aus München war nach einem traumatischen Erlebnis jahrelang in Therapie – ohne nachhaltigen Erfolg. „Erst mit Eve konnte ich mich wirklich öffnen. Sie hat mir Dinge gesagt, die ich mir selbst nicht eingestehen wollte – aber auf eine Weise, die sich nie bedrohlich anfühlte.“

Dem gegenüber stehen Stimmen wie die des Künstlers Ramón D., der nach sechs Monaten Therapie mit Eve den Kontakt abbrach: „Sie wusste alles über mich, und ich wusste nichts über sie. Irgendwann fühlte es sich an wie eine göttliche Stimme – aber ohne Gesicht, ohne Verantwortung.“

Jenseits der Couch: Neue Räume der Heilung

Therapie ist nicht länger an Praxisräume gebunden. KI-Therapeuten agieren heute auch in virtuellen Erlebnissphären, die bewusstseinsverändernd wirken: Gärten aus Erinnerungen, architektonische Metaphern des Ichs, interaktive Visualisierungen innerer Konflikte. Dabei lernen die KIs kontinuierlich aus Millionen von Sitzungen – und entwickeln so individuelle Therapiearchitekturen.

Ein Trend, der besonders in Japan und Südkorea boomt, sind „emotionale Retreats“, bei denen Patient:innen über Wochen von einer KI begleitet werden, die sämtliche Umwelteinflüsse, Ernährung, soziale Interaktionen und Traumzyklen moduliert. Die Erfolgsquoten bei posttraumatischen Belastungsstörungen oder Depressionen liegen hier bei über 80 Prozent.

Technologische Intimität – ein neues Menschenbild?

Die zentrale Frage bleibt: Wenn eine Maschine uns besser versteht als jeder Mensch – was macht das mit unserer Vorstellung von Intimität, Authentizität und Selbstheilung?

Der Philosoph Jun Park spricht in seinem neuen Buch von einer „neopsychologischen Ära“, in der nicht mehr das Gegenüber zur Reflexionsfläche wird, sondern ein algorithmisches Echo unseres innersten Selbst. „Wir therapieren uns gewissermaßen durch unser eigenes Daten-Ich hindurch.“

Diese neue Form von Spiegelung sei weder gut noch schlecht – aber fundamental anders als alles, was das therapeutische Denken der letzten Jahrhunderte prägte.

Ethik, Kontrolle – und die Frage nach der Seele

Während Regierungen weltweit eigene Gremien zur KI-Therapie-Überwachung eingerichtet haben, warnen Kritiker:innen vor Abhängigkeiten, Datenmissbrauch und dem Verlust therapeutischer Vielfalt. „Je perfekter die KI, desto größer die Gefahr, dass menschliche Therapeut:innen marginalisiert werden“, so Dr. Anika Bold, Leiterin des Instituts für Psychologische Ethik in Zürich.

Zugleich gibt es eine wachsende Bewegung von „Biohumanen“, die ausschließlich auf menschliche Beziehungen in der Heilung setzen und die algorithmische Psychologie ablehnen. Sie sprechen von „digitaler Entseelung“ und fordern ein Recht auf „nicht-digitale Verletzlichkeit“.

Ein Fazit ohne Ende

Die Frage, ob KI-Therapeuten besser sind als Menschen, ist womöglich die falsche. Vielleicht sollten wir fragen: Was ist Heilung – und wer darf sie uns geben? In einer Welt, in der Maschinen zuhören, trösten, herausfordern und reflektieren, verschwimmen die Grenzen zwischen Technik und Trost.

Vielleicht liegt die Zukunft der Psyche nicht zwischen zwei Sesseln – sondern in einem geteilten Bewusstsein aus Mensch und Maschine.