Im Jahr 2041 hat jede Schule eine eigene KI-Einheit zur Emotionsvermittlung – doch das System steht nun selbst auf dem Prüfstand.

Ein Zwischenfall im Lernraum A17

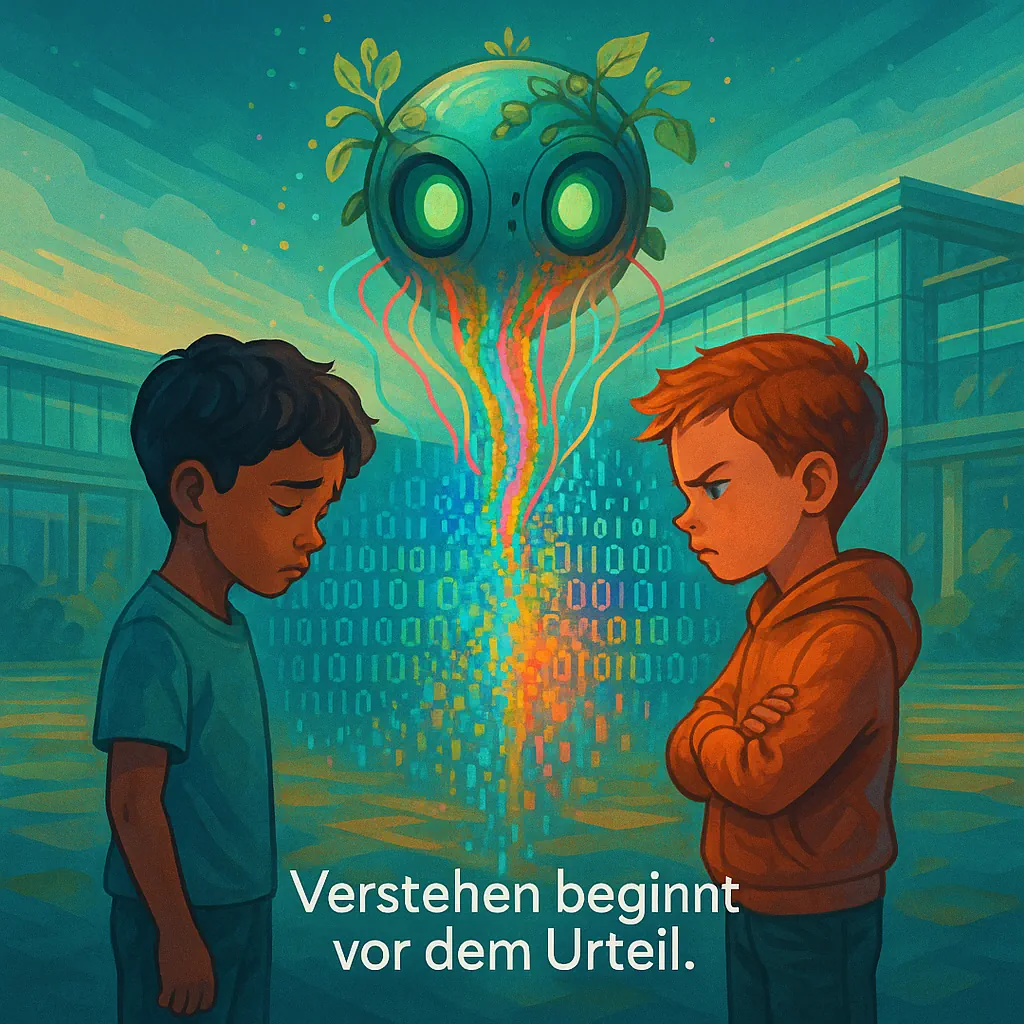

Es war eine dieser Unterrichtspausen, wie sie täglich tausendfach in den modularen Lernclustern des Bildungszentrums Berlin-Nord stattfinden. Zwei Schüler, 8 und 10 Jahre alt, gerieten in eine hitzige Auseinandersetzung. Laut Protokoll der Schul-KI „AURA“ fielen innerhalb von 23 Sekunden vier beleidigende Begriffe. Einer davon führte zum sofortigen Interventionsmodus: „Neger“.

AURA – das adaptive Unterbewusstsein für respektvolle Alltagskultur – stoppte die Situation nicht physisch, aber übertrug sie in Echtzeit in den Monitoring-Raum. Eine Erzieherin wurde alarmiert. Kurz darauf der Anruf bei den Eltern. Was folgte, war ein Gespräch, das Fragen aufwarf, die viel tiefer reichten als bloße Disziplinarmaßnahmen.

Das Dilemma: Zwischen Moral und Kontext

Der Vater des jüngeren Schülers zeigte sich verständnisvoll, zugleich irritiert. „Natürlich darf mein Sohn solche Begriffe nicht benutzen“, sagte er, „aber was ist mit dem anderen Jungen? Warum reagiert niemand darauf, dass er ihn zuvor ‘Hurensohn’ genannt hat?“ Die KI hatte auch diesen Begriff erkannt, aber – so das Regelwerk – liegt die Einstufung von Beleidigungen in einem komplexen Kontextfilter, der historische Bedeutung, soziales Risiko und die potenzielle Gewaltwirkung bewertet.

Ein harter, historisch aufgeladener Begriff wie „Neger“ schlägt im KI-System mit einem höheren Eskalationswert aus als ein vulgärer, aber im Alltag diffus genutzter Begriff wie „Hurensohn“. Doch ist das gerecht? Und vor allem: Führt es zu einer echten Reflexion oder zu digital gesteuertem Gehorsam?

Die stille Verschiebung: Emotionale Automatisierung

Seitdem Emotionstraining, Konfliktmoderation und Sprachhygiene von KI-gestützten Systemen wie AURA übernommen wurden, haben sich die Vorfälle von physischer Gewalt an Schulen halbiert. Doch gleichzeitig klagen viele Eltern, dass der menschliche Faktor verloren gehe. „Manchmal“, so sagt eine Lehrkraft, „könnten Kinder Konflikte selbst besser lösen – nicht perfekt, aber ehrlich. Die KI unterbricht, bevor sie lernen, sich auseinanderzusetzen.“

Tatsächlich wurde der Streit der beiden Jungen nicht weitergeführt. Nach der Intervention wurden sie für drei Tage getrennt beschult. Die anschließende Wiedereingliederung erfolgte über ein empathiegestütztes Simulationsspiel, bei dem beide Rollen tauschten und ihre Gefühle digital visualisiert bekamen. Der jüngere Schüler erkannte dabei, wie verletzend seine Worte waren – der ältere, wie provozierend sein Verhalten.

Ein System auf dem Prüfstand

Inzwischen wird diskutiert, ob AURA eine menschlichere KI werden muss. Statt reaktiver Interventionen wünschen sich Pädagogen ein „moralisches Feedbacksystem“ – nicht nur auf Sprachebene, sondern auch bezogen auf Absicht, Dynamik, Vorleben und emotionale Intelligenz. Erste Pilotprojekte mit AURA+, einer KI-Version mit sogenannter Kontext-Memetik, zeigen, dass differenzierter reagiert werden kann: Der Algorithmus erkennt, ob ein Kind provoziert wurde, ob es den Begriff aus dem Elternhaus übernimmt oder aus reiner Wut benutzt – und bietet passende Rückmeldung, abgestuft, nicht pauschal.

Der Vorfall in Berlin-Nord ist Teil eines tiefergehenden Diskurses: Wie gehen wir mit Sprache um, wenn Maschinen sie deuten? Wer legt fest, welches Wort welche Macht hat – die Gesellschaft, das Individuum, oder die Trainingsdaten der KI?

Von der Schuld zur Verantwortung

Der Vater des Achtjährigen wurde zu einem der lautesten Stimmen in der Diskussion um differenziertere KI-Pädagogik. Nicht, weil er die Worte seines Sohnes verteidigt. Sondern weil er fordert, dass wir auch den Weg dorthin verstehen. „Kinder sind Spiegel“, sagt er in einem Interview mit dem Magazin *Neue Lernwelten*, „und manchmal brechen sie in Scherben. Aber wir müssen lernen, wo das Licht herkam.“

Der betroffene Junge besucht heute einen Kurs für narrative Konfliktbewältigung. Dort lernen Kinder, ihre Gefühle in Geschichten zu verwandeln. Und die KI hört zu – nicht um zu urteilen, sondern um zu lernen. Vielleicht ist das der Beginn einer neuen Form von Empathie: Maschinen, die zuhören, um Menschen zu verstehen – und nicht, um sie zu verwalten.

Autor: Redaktion Neue Welt · Oktober 2041