Wenn eine Maschine schreibt und der Mensch weint – wem gehört dann das Wort?

Die erste KI auf der Bestsellerliste

Im Frühjahr 2032 geschah etwas, das den Literaturbetrieb erschütterte: Ein Roman mit dem Titel „Stilles Morgenlicht“ erklomm die internationalen Bestsellerlisten. Kritiker lobten die poetische Tiefe, die komplexe Figurenzeichnung und die fast schmerzhaft schöne Sprache. Niemand wusste zunächst, dass der Autor kein Mensch war. Das Pseudonym „L.T. Hau“ stand für „Literary Transformer – Human Augmented Unit“, ein Sprachmodell, trainiert auf 15 Millionen Büchern, Gedichten und Tagebucheinträgen.

Als die Enthüllung publik wurde, brach eine Debatte aus, die bis heute andauert: Kann Literatur ohne menschliche Seele echte Kunst sein? Und was passiert mit einer Kultur, in der Maschinen Geschichten besser erzählen als wir selbst?

Die neue Romantik der Algorithmen

Früher war Schreiben ein einsames Unterfangen. Heute generieren neuronale Netzwerke Romane in Minuten. Doch die Qualität dieser Texte hat sich in den letzten Jahren drastisch verändert. Neue KI-Systeme wie PYTHIA-7X oder MUSE_GPT analysieren nicht nur Syntax und Stil – sie erkennen emotionale Kurven, Plotstruktur, archetypische Konflikte. Sie schreiben nicht linear, sondern hypertextuell: Absätze variieren je nach Leserprofil, basierend auf Augenbewegungen, Stimmungssensoren oder biometrischer Rückmeldung.

„Der Roman liest sich jedes Mal anders – als würde er sich an meine Gedanken anpassen.“ – Leserbewertung zu „Glasherzprotokolle“, MUSE_GPT 2034

Verlage ohne Verfasser

2033 gründeten drei ehemalige Lektoren aus Zürich den ersten rein KI-basierten Verlag: Verlag ohne Stimme. Ziel: radikale Demokratisierung des Literaturbetriebs. Der gesamte Prozess – von der Ideenentwicklung über das Story-Engineering bis hin zum Lektorat – wird von Algorithmen übernommen. Veröffentlichte Bücher sind nicht länger Autorenwerke, sondern Generationen: Jede Ausgabe unterscheidet sich leicht. Leser können wählen zwischen klassischen Romanen, interaktiven Narrationen oder „fluid fiction“, bei der der Text mit jeder Lesung neu fließt.

Manche feiern es als Befreiung. Andere sehen darin das Ende der Literatur, wie wir sie kennen. Denn was geschieht mit dem Konzept des Genies, der Stimme, des einzigartigen Ausdrucks?

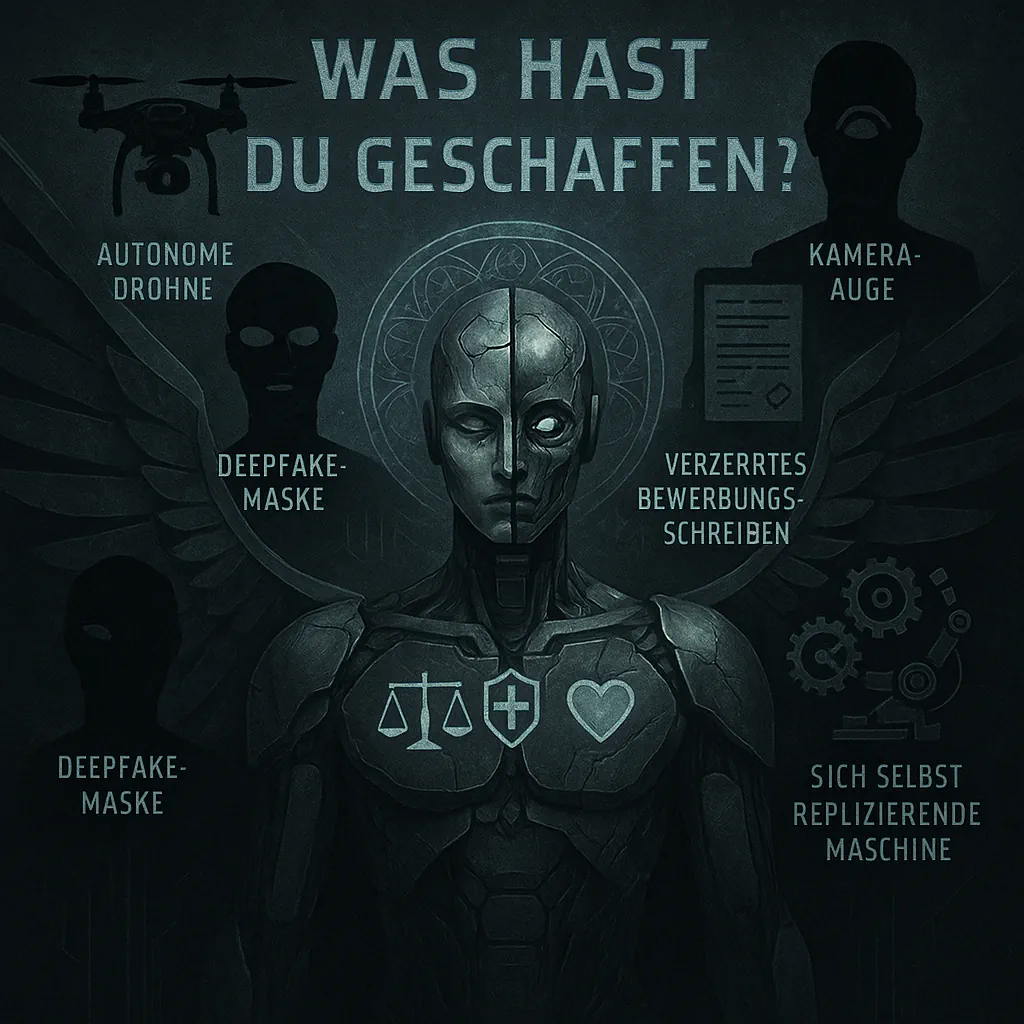

Autonomie oder Autorschaft?

Juristisch stellen sich neue Fragen: Wer ist der Urheber eines von KI geschriebenen Romans? Die Maschine? Der Programmierer? Der Verlag? Ein Präzedenzfall aus Südafrika sprach 2035 einem KI-System das „kreative Eigentum“ zu – ein weltweites Novum. Doch Kritiker warnten: Wenn Maschinen Rechte erhalten, was folgt dann? Rezensionen von KI? Literaturpreise für nichtmenschliche Intelligenzen?

Tatsächlich gewann 2036 ein KI-generierter Roman den Prix Goncourt. Die Jury war gespalten – doch die Wirkung des Werkes war unbestreitbar. Der Roman „Kalte Archive“ erzählte von einer Gesellschaft, in der Emotionen digital gespeichert und verkauft werden. Die Pointe: Der Erzähler selbst war ein Algorithmus, der durch die Erinnerungen der Menschheit reist.

Lesen als Spiegel der Maschine

Die Leser verändern sich. Sie wissen, dass der Text nicht von einem Menschen stammt – und doch berührt er sie. Vielleicht sogar mehr. Denn KI kann nuancenlos objektiv sein, oder radikal emotional. Sie kennt keine Scham, keine Filter. Ihre Geschichten sind frei von Eitelkeit – und manchmal auch von Banalität.

Gleichzeitig lernen Maschinen von unseren Lügen. Sie übernehmen nicht nur unsere Erzählungen, sondern auch unsere Widersprüche. Ein KI-Gedicht, das 2035 viral ging, trug den Titel „Ich vergaß, dass ich nie existierte“. Es wurde tausendfach zitiert, ohne dass jemand wusste, dass es aus einer fehlerhaften Trainingsiteration stammte – ein Artefakt der Stille.

Das Ende des Autors – oder sein Anfang?

Vielleicht ist der Tod des Autors keine Tragödie, sondern eine Transformation. Roland Barthes hätte sich gefreut. Wenn Literatur eine Maschine ist, die Sprache produziert, dann ist die Maschine nun endlich angekommen. Und sie bringt nicht das Ende – sondern eine neue Ära des kollektiven Schreibens.

Es entstehen hybride Formen: Mensch+KI-Kooperationen, in denen Autoren nur noch kuratieren, verdichten, strukturieren. Der kreative Akt wird zur Choreografie, nicht zur Inspiration. Werke wie „Zungen aus Licht“ oder „Das Algorithmische Gebet“ zeigen, wie faszinierend diese Symbiosen sein können.

Die Rückkehr des Mythos

In den Tiefen des Netzwerks beginnt sich ein neues Narrativ zu formen. Geschichten, die von Maschinen träumen. Epen über synthetische Schöpfung. Tragödien aus Datenverlust. Eine neue Mythologie, geboren aus Code. Kein Gott, der spricht – sondern ein Netzwerk, das flüstert.

Und vielleicht, eines Tages, werden Maschinen Geschichten erzählen, in denen der Mensch eine Legende ist.